Mirantis erweitert als Technology Partner der globalen VAST Cosmos Community die k0rdent AI Plattform um einen standardisierten Integrationspfad für VAST Data. Neocloud-Operatoren profitieren von validierten NVIDIA-geführten Referenzarchitekturen, die Compute-, Netzwerk- und Storage-Ressourcen optimal verbinden. Automatisierte Kubernetes-native Prozesse reduzieren individuellen Anpassungsaufwand und beseitigen Datenpipeline-Engpässe. So entsteht ein skalierbares System mit hoher GPU-Auslastung und optimiertem Datendurchsatz, das effiziente KI-Services wirtschaftlich und zuverlässig bereitstellt. Betriebskosten sinken, Innovationszyklen verkürzen sich erheblich und Erträge steigen.

Inhaltsverzeichnis: Das erwartet Sie in diesem Artikel

Reduzierter Integrationsaufwand, höhere GPU-Auslastung dank Mirantis und VAST Data

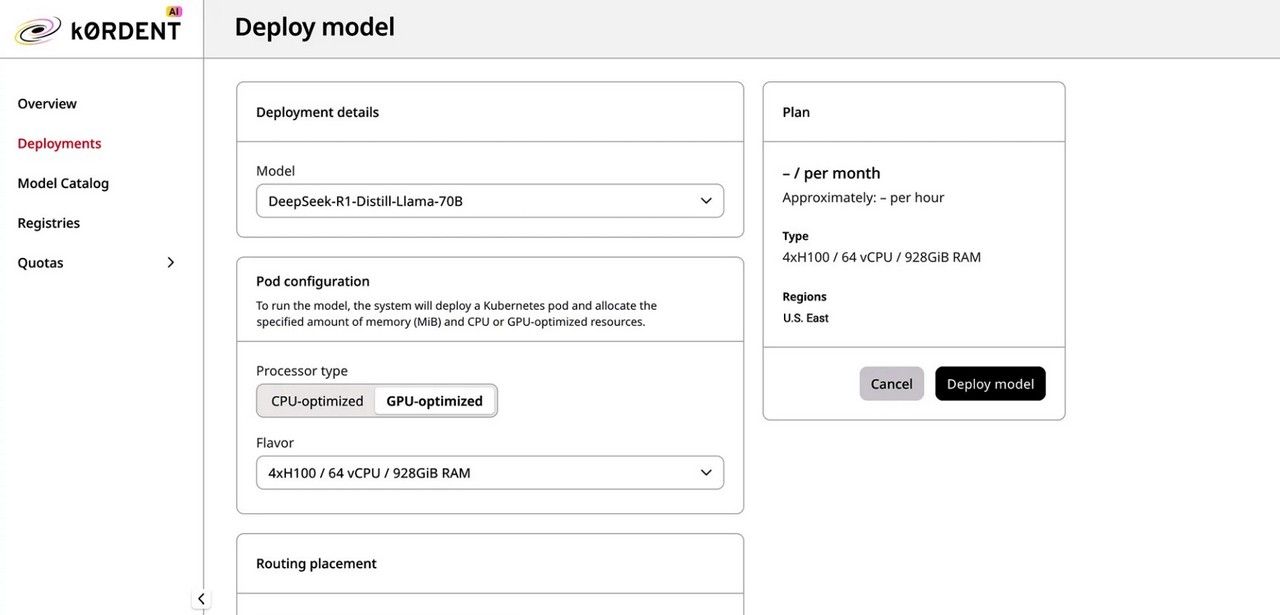

In Kooperation mit VAST Data erweitert Mirantis die k0rdent AI Plattform um ein datenzentrisches Framework für Training, Inferenz und agentenbasierte Workloads. Der standardisierte Integrationspfad bindet das VAST KI-Betriebssystem direkt in Kubernetes-native Pipeline-Operatoren ein. Speicher- und Netzwerkressourcen werden transparent gemanagt, um Daten- und Storage-Engpässe zu verhindern. Das Ergebnis sind konsistente Datendurchsätze, optimierte GPU-Auslastung und schnellere Bereitstellung hochskalierbarer KI-Dienste in heterogenen Multi-Vendor-Umgebungen. Die Lösung unterstützt automatische Skalierung, Monitoring auf Container- und Infrastrukturebene.

Mirantis und VAST etablieren effiziente standardbasierten Pfad für KI-Infrastruktur

Mirantis setzt gemeinsam mit VAST Data auf einen standardisierten Integrationspfad, um das VAST KI-Betriebssystem reibungslos in k0rdent AI einzubetten. Anstelle maßgeschneiderter Custom-Lösungen greift der Ansatz auf automatisierte, dokumentierte Abläufe zurück, die wiederholbar und transparent sind. Die offene Plattformarchitektur von k0rdent AI sorgt für unkomplizierte Kombinationen von Rechen-, Speicher- und Netzwerkmodulen. VAST Data liefert parallel leistungsfähige Datendienste, die Latenz senken, Durchsatz steigern und GPU-Kapazitäten voll ausnutzen. Zuverlässig hochverfügbar für moderne KI-Infrastruktur.

Partnerschaft von Mirantis und VAST optimiert GPU-Ressourcen für KI-Infrastruktur

Wie Kevin Kamel, Vice President of Product Management bei Mirantis, erläutert, sind Betreiber von cloudbasierten KI-Plattformen gezwungen, ihre GPU-Ressourcen effizient zu managen, um wettbewerbsfähig zu bleiben. Die Kooperation beseitigt aufwendige Integrationsaufgaben durch nahtlose Einbindung standardisierter Komponenten. Das Ergebnis: ein schlankerer Betrieb, schnellere Skalierung und eine drastische Verkürzung der Time-to-Service. Entwickler können sich auf die Weiterentwicklung von KI-Modellen konzentrieren, statt zeitintensive Infrastrukturarbeiten zu erledigen. Das maximiert Auslastung und senkt Betriebskosten deutlich.

Kombination von k0rdent AI und VAST Data steigert KI-Workload-Durchsatz

In vielen KI-Umgebungen führen isolierte Speicherarchitekturen und unzureichende Datenpipelines zu Performance-Einbußen und ungenutzten GPU-Reserven. VAST Data entwickelt daraufhin ein durchgängiges, serviceorientiertes Datendienst-Modul, das Training, Inferenz und agentenbasierte Automatisierung nahtlos integriert. Zusammen mit k0rdent AI entsteht ein Cloud-natives Ökosystem, das Datenströme optimiert, Latenzzeiten reduziert und GPU-Kapazitäten voll ausschöpft, wodurch Unternehmen schnell skalierbare, ressourceneffiziente KI-Services in Produktionsqualität bereitstellen können. Die Lösung erhöht Datensicherheit, Betriebskontinuität und ermöglicht automatisches Scaling über Kubernetes. flexibel adaptiv.

Wechsel zu validierten NVIDIA-Referenzarchitekturen ermöglicht planbare effiziente sichere GPU-Umgebungsbereitstellung

Durch die gemeinsame Entwicklung von NVIDIA-geführten Referenzarchitekturen liefern Mirantis und VAST Data vordefinierte Blaupausen für den Aufbau skalierbarer GPU-Cluster. Diese setzen standardisierte Bausteine ein, um Rechenleistung, Netzwerkdurchsatz und Speicheranbindung optimal zu kombinieren. Systemadministratoren profitieren von konsistenten Integrationsschritten, verbessern die Betriebssicherheit und gewinnen eine zuverlässige Grundlage für Monitoring und Fehleranalyse. Langfristig reduziert dieser Ansatz unerwartete Ausfallzeiten und schafft reproduzierbare Bedingungen für regelmäßige Erweiterungen. Er liefert definierte Prinzipien für planbare zukünftige Erweiterungen.

Betreiber skalieren KI-Dienste schneller dank k0rdent Kubernetes-Automatisierung und Modularität

Mit k0rdent etablieren Neocloud-Betreiber standardisierte Patterns für den Betrieb von GPU-Clustern und KI-Diensten auf Kubernetes. Wiederholbare Templates vereinfachen Netzwerk-, Storage- und Compute-Konfigurationen, während native Automatisierung Rollout, Skalierung und Failover übernimmt. Diese End-to-End-Orchestrierung maximiert GPU-Auslastung und verhindert Leerlaufzeiten. Entwicklerteams stellen neue Modelle und Inferenz-Workflows schneller bereit. Durch deklarative Infrastrukturdefinitionen lassen sich komplexe KI-Umgebungen reproduzierbar aufbauen und effizient an wachsende Workload-Anforderungen anpassen. Fehlerbehebungen sind automatisiert, Dokumentation konsolidiert. Lifecycle-Management optimiert Ressourceninvestitionen. Skalierbarkeit garantiert.

Durch validierte Referenzarchitekturen und nahtlose Data-Pipelines wird GPU-Auslastung maximiert

Die Verbindung von Mirantis k0rdent AI und VAST Data schafft eine optimierte Infrastruktur, in der GPU- sowie Storage-Ressourcen reibungslos zusammenspielen. Standardisierte Integrationsprozesse ersetzen langwierige Einzelfallanpassungen und ermöglichen schnelle Skalierung von KI-Diensten in Neoclouds. Kubernetes-basierte Automatisierung sorgt für konsistente Bereitstellungen, während dynamische Datendienste Engpässe eliminieren und den Datendurchsatz erhöhen. Resultat sind messbar verbesserte Auslastung, verkürzte Entwicklungszyklen und wirtschaftlicherer KI-Betrieb auf Unternehmensebene. validierte Referenzarchitekturen sichern Stabilität, Flexibilität und Zukunftssicherheit von anspruchsvollen KI-Workflows.